• Trong 6 tháng đầu năm 2025, Việt Nam ghi nhận:

• > 8,5 triệu tài khoản bị đánh cắp

• Khoảng 530.000 cuộc tấn công DDoS (Distributed Denial of Service)

• 191 vụ lộ dữ liệu (“data breaches”) với hơn 3 tỉ bản ghi bị ảnh hưởng

• Đáng chú ý, so với cùng kỳ năm trước, con số này gấp khoảng 3 lần về mức độ ảnh hưởng dữ liệu & số lượng vụ lộ thông tin.

________________________________________

Các hình thức tấn công mới sử dụng AI

Cuộc hội nghị nhấn mạnh nhiều dạng tấn công dựa trên AI đã xuất hiện / gia tăng, bao gồm:

1. Email lừa đảo được cá nhân hóa (phishing cá nhân hóa)

AI được dùng để phân tích thông tin công khai / từ rò rỉ dữ liệu, đánh giá “tiềm năng mục tiêu”, và soạn những email rất giống người thật, khó phân biệt.

2. Deepfake giả mạo hình ảnh khuôn mặt

Sử dụng công nghệ AI để tạo giả mạo khuôn mặt / video / hình ảnh nhằm đánh lừa hệ thống nhận dạng (face recognition), hoặc để lừa cá nhân / tổ chức tin tưởng nội dung giả.

3. Mã độc tự biến đổi (self-mutating malware)

Phần mềm độc hại có khả năng thay đổi hành vi / mã / cấu trúc khi bị phát hiện hoặc khi di chuyển trong hệ thống, nhằm qua mắt các hệ thống phát hiện truyền thống. AI hỗ trợ khả năng “tự học” hoặc “tự thích nghi” để né các biện pháp phòng thủ.

4. Tấn công tự động hóa bằng AI

AI được sử dụng để tự động hóa từng bước: reconnaissance (thu thập thông tin), tìm lỗ hổng, tạo và thử exploit, điều phối tấn công (ví dụ botnet DDoS) — làm tăng tốc và qui mô tấn công.

________________________________________

Những thách thức chính được nêu ra

• Các hệ thống phòng thủ truyền thống (firewall, hệ thống phát hiện xâm nhập IDS/IPS, phương pháp dựa quy tắc cố định) khó thích ứng nhanh trước mã độc / tấn công sử dụng AI, vì tính biến đổi & tốc độ.

• Việc xử lý / phản hồi sự cố mạng (incident response) cần diễn ra nhanh hơn, vì AI làm cho tấn công có thể lan nhanh, phức tạp hơn.

• Rủi ro từ việc lộ dữ liệu lớn: khi dữ liệu bị rò rỉ, hacker có thể dùng dữ liệu đó để huấn luyện các mô hình AI phục vụ tấn công (ví dụ phishing, impersonation).

• Thiếu sự phối hợp & chia sẻ thông tin giữa các tổ chức / doanh nghiệp để phản ứng sớm với các mối đe dọa mới.

• Chính sách, quy định, khung pháp lý chưa theo kịp thực tiễn, đặc biệt trong việc kiểm soát việc tạo / sử dụng deepfake, AI agents, mã độc tự biến đổi.

________________________________________

Giải pháp & khuyến nghị được đề xuất

• Chuyển từ tư duy phòng thủ thụ động sang chủ động:

Ví dụ, mô hình CNADR (Cloud-Native AI-Driven Response) được nêu lên như một xu hướng cần triển khai hơn — tức là hệ thống phản ứng sự cố mạng sử dụng AI làm trung tâm, tích hợp với cơ sở hạ tầng đám mây, để phát hiện & xử lý nhanh & chủ động hơn.

• Xây dựng & phát triển cộng đồng chia sẻ trong nước:

Ví dụ VCS Intel Hub – cộng đồng an toàn thông tin để chia sẻ cảnh báo sớm, phối hợp ứng cứu, chia sẻ kiến thức, kinh nghiệm thực chiến.

• Tăng cường năng lực thực chiến & đào tạo:

Hoạt động “Cyber War Game”, Red Team / Blue Team, mô phỏng tấn công thực tế để giúp các bên hiểu rõ các kỹ thuật mới, nâng cao phản ứng.

• Củng cố khung chính sách & quy định:

Đề xuất hoàn thiện luật / nghị định liên quan đến AI, bảo mật dữ liệu, privacy, kiểm soát deepfake, và trách nhiệm khi để lộ dữ liệu.

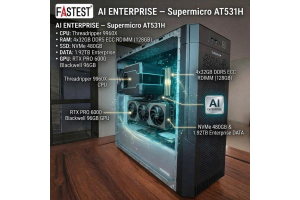

• Đầu tư công cụ & hệ thống mới:

Ứng dụng AI trong phòng thủ: phát hiện anomalous behaviour, giám sát mạng lưới liên tục, tự động hóa phân tích logs, xác định mối đe dọa mới.

VN

VN

VN

VN

ENG

ENG